Svet nije obratio pažnju kada je kompanija OpenAI u junu 2018. godine bez ikakve medijske pompe objavila tehnički rad pod nazivom “Improving Language Understanding by Generative Pre-Training”. Prvi GPT-1 (Generative Pre-trained Transformer) nije imao marketinšku kampanju, milijarderske investitore koji daju intervjue, niti interfejs dostupan širokim masama. Bio je to strogo zatvoren akademski eksperiment dizajniran da reši fundamentalni problem u razvoju veštačke inteligencije: zavisnost od ljudski obeleženih podataka.

Do tog trenutka, napredni AI modeli su zahtevali armije inženjera koji su ručno kategorizovali gigabajte teksta kako bi mašina razumela šta čita. Radikalan potez sa GPT-1 modelom bila je primena nenadziranog učenja. Inženjeri su dokazali da algoritam može samostalno da dekodira sintaksu, gramatiku i semantiku jezika isključivo pokušavajući da statistički predvidi koja reč sledi sledeća u masivnom bloku teksta.

Arhitektura i pogonsko gorivo Tehnička osnova sistema bazirala se na Transformer arhitekturi koju je Google izumeo 2017. godine, ali ju je OpenAI modifikovao u “dekoder-samo” strukturu, optimizovanu isključivo za generisanje sekvenci reči.

- Trening korpus: Model nije treniran na nasumičnim internet člancima, Wikipediji ili forumima. Njegov jedini izvor znanja bila je baza podataka BookCorpus, koja je sadržala 7.000 neobjavljenih romana različitih žanrova (od trilera do naučne fantastike). Knjige su ciljano odabrane jer zahtevaju praćenje dugoročnog narativnog konteksta, za razliku od kratkih formi na internetu.

- Kapacitet i snaga: Sistem je raspolagao sa tačno 117 miliona parametara. Iz današnje perspektive, gde modeli imaju bilione parametara, ovo deluje kao mikroskopski broj, ali je 2018. godine predstavljao apsolutnu gornju granicu tadašnje računarske moći.

- Zero-shot fenomen: Najvrednije tehničko otkriće bilo je to što je GPT-1, iako programiran samo da “pogađa sledeću reč”, spontano naučio osnove prevođenja, analize sentimenta i odgovaranja na logička pitanja. Nije bilo posebnog koda za te funkcije – model ih je apstrahovao iz samih knjiga.

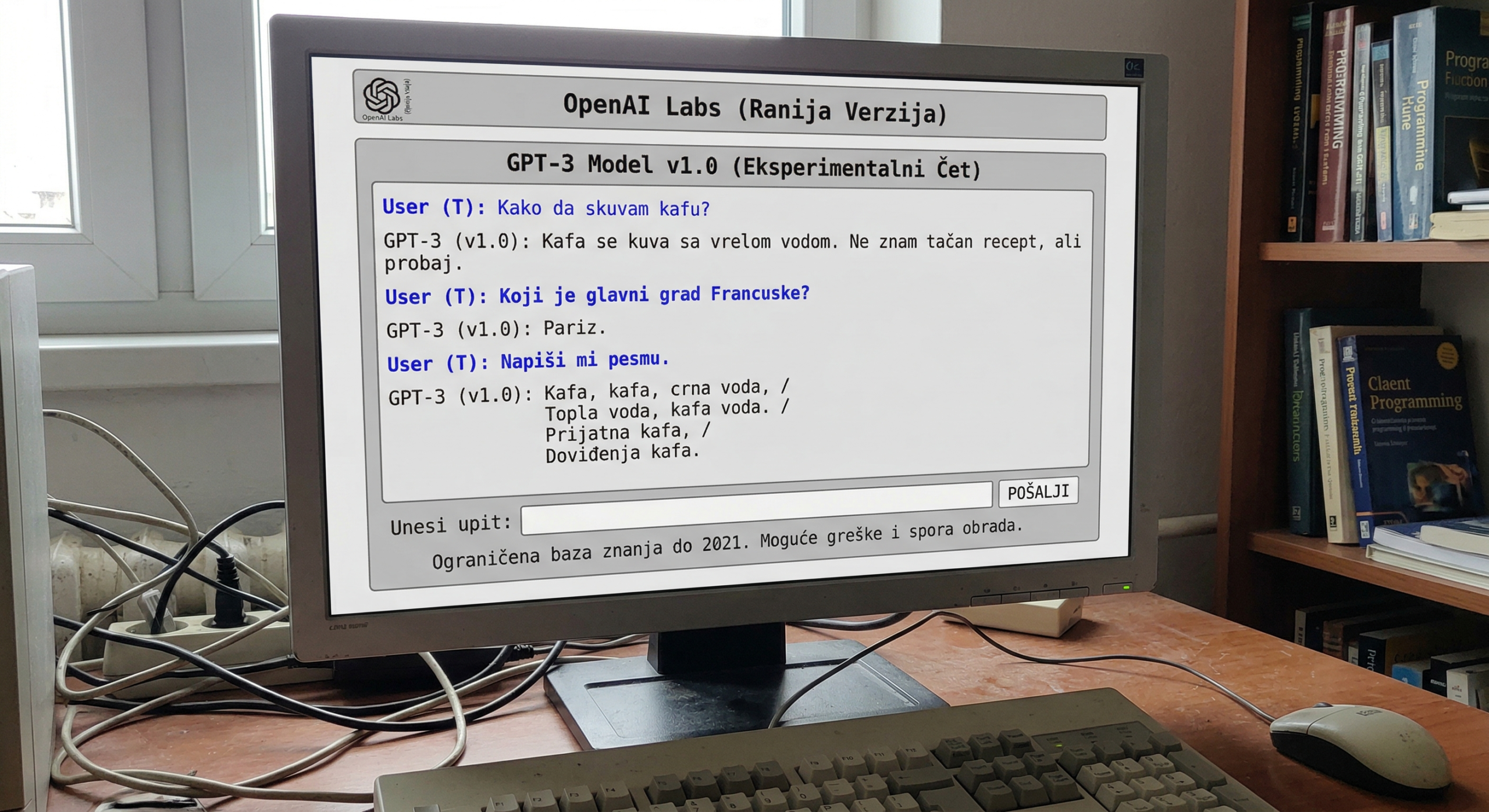

Sirova realnost prve verzije Iza kulisa, interakcija sa GPT-1 nije imala nikakve sličnosti sa današnjim ChatGPT-om.

- Nije postojao prozor za ćaskanje. Komunikacija se odvijala isključivo kroz crni prozor terminala kucanjem serverskih komandi.

- Model je patio od hroničnog “zaboravljanja”. Nakon generisanja samo nekoliko pasusa, sistem bi izgubio tehničku nit i počeo da ispisuje ponavljajuće, besmislene blokove reči.

- Sistem je bio lišen bilo kakvih sigurnosnih protokola ili filtera za usklađivanje (alignment). Izbacivao je sirov, necenzurisan tekst na osnovu onoga što je usvojio tokom treninga.

Istorijsko nasleđe GPT-1 nije dizajniran da bude komercijalni proizvod. Njegova jedina svrha bila je dokaz koncepta. Uspeh ovog modela dao je inženjerima surov, ali jasan signal: matematička arhitektura funkcioniše besprekorno, a jedini sledeći logičan korak jeste brutalno povećanje hardverskih resursa i obima podataka. Taj zaključak je direktno doveo do stvaranja GPT-2, a zatim i do globalne promene paradigme sa GPT-3 i GPT-4.